2025 年 9 月時点 Windows 版 Ollama をインストールして API を試したメモ

2025 年 9 月時点 Windows 版 Ollama をインストールして API を試したメモです。

Windows 版 Ollama のアプリケーションが新しくリリースされた

2025 年 9 月時点の情報で進めます。

Ollama's new app · Ollama Blog

こちらの記事で気づいたのですが Windows で Ollama を使うときにアプリケーションとしてインストールして使えて、しかも API サーバーもちゃんと立つということが分かったので試してみます。

インストールしてみる

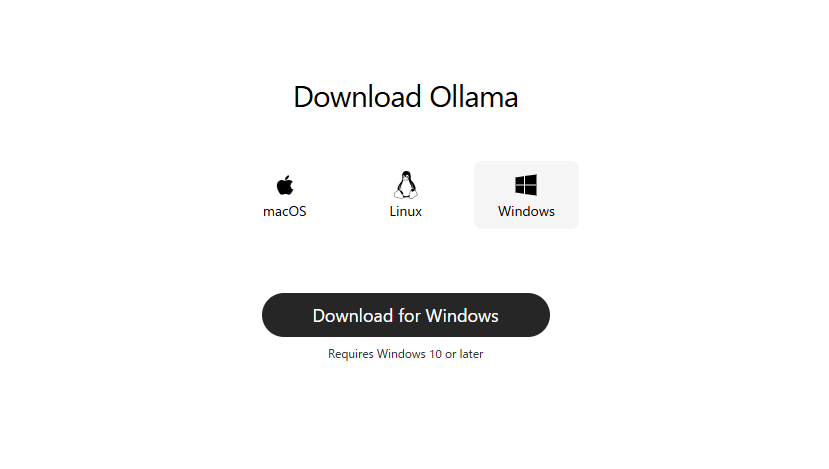

Download Ollama on Windows にアクセスして Windows インスト-ラをダウンロードします。

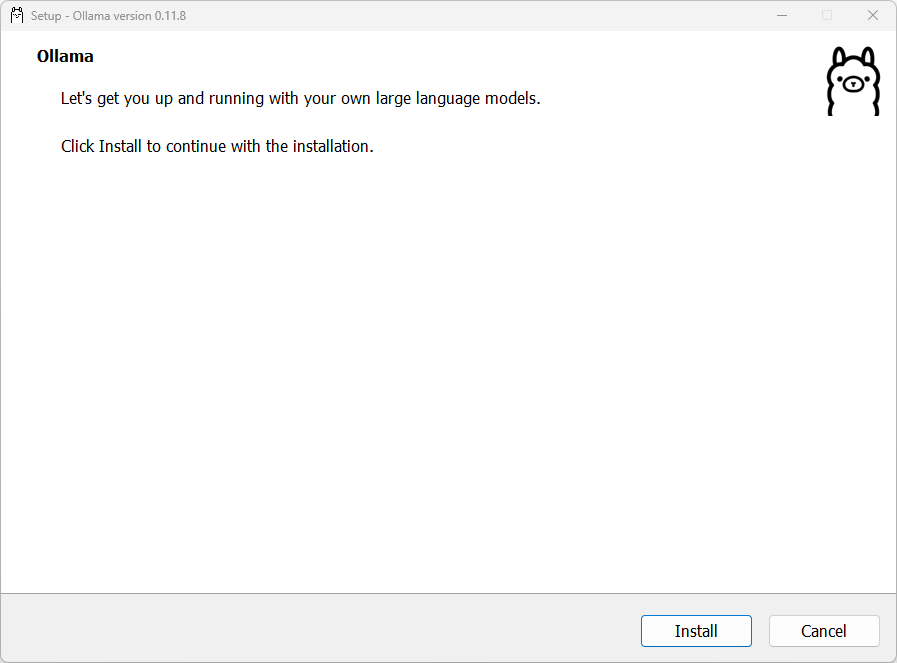

インストーラーがダウンロードされました。

インストールをクリックします。

インストールが進みます。

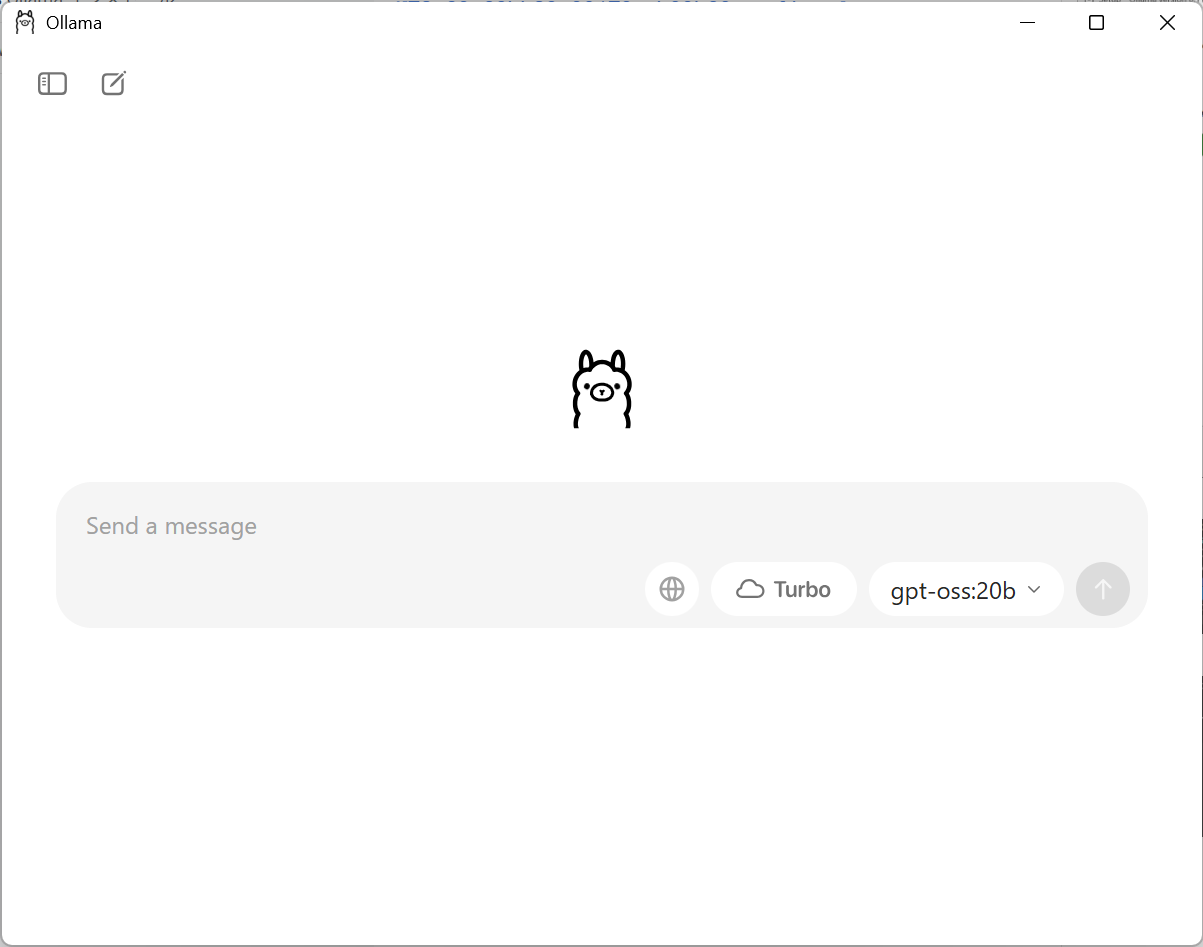

起動しました。いいかんじ!

モデルダウンロード

モデルをダウンロードしてみます。

まずチャット入力の UI の右下のモデルを選んで granite3.3:2b を入力してみます。これは Ollama Search でモデルを探した上での各モデルの名称です。

今回は Granite 3.3 2b モデルです。一致していると選択肢が出てきます。

これでメッセージを打ってみます。

そうすると、このタイミングでモデルダウンロードが開始されます。

しばらく待ってインストールが完了して回答が返ってきます。

API を軽く試してみる

このアプリが常駐していれば ollama serve する必要なく API サーバーが立ち上がっています。

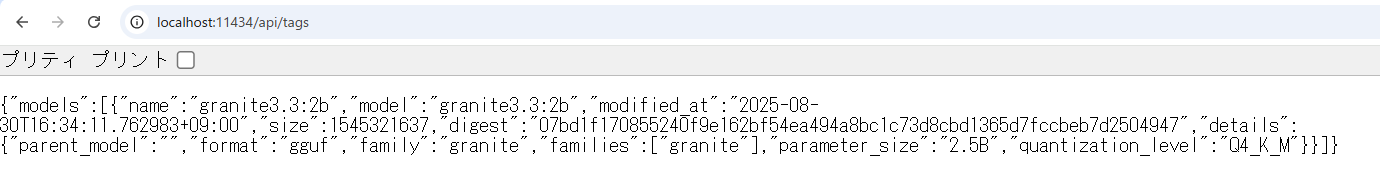

たとえばモデル一覧を表示する http://localhost:11434/api/tags を叩いてみると、

{

"models": [

{

"name": "granite3.3:2b",

"model": "granite3.3:2b",

"modified_at": "2025-08-30T16:34:11.762983+09:00",

"size": 1545321637,

"digest": "07bd1f170855240f9e162bf54ea494a8bc1c73d8cbd1365d7fccbeb7d2504947",

"details": {

"parent_model": "",

"format": "gguf",

"family": "granite",

"families": [

"granite"

],

"parameter_size": "2.5B",

"quantization_level": "Q4_K_M"

}

}

]

}このように、先ほどインストールしたモデルを含めた一覧が表示できました。もちろんチャット API やモデルの削除といったような他の API も動きました。

いままで WSL に Ollama を入れて、それ経由でやり取りしていたので、こういう風にちゃんとアプリケーションで動き API も普通にアクセスできるのは、仕組みがシンプルになってありがたいです。